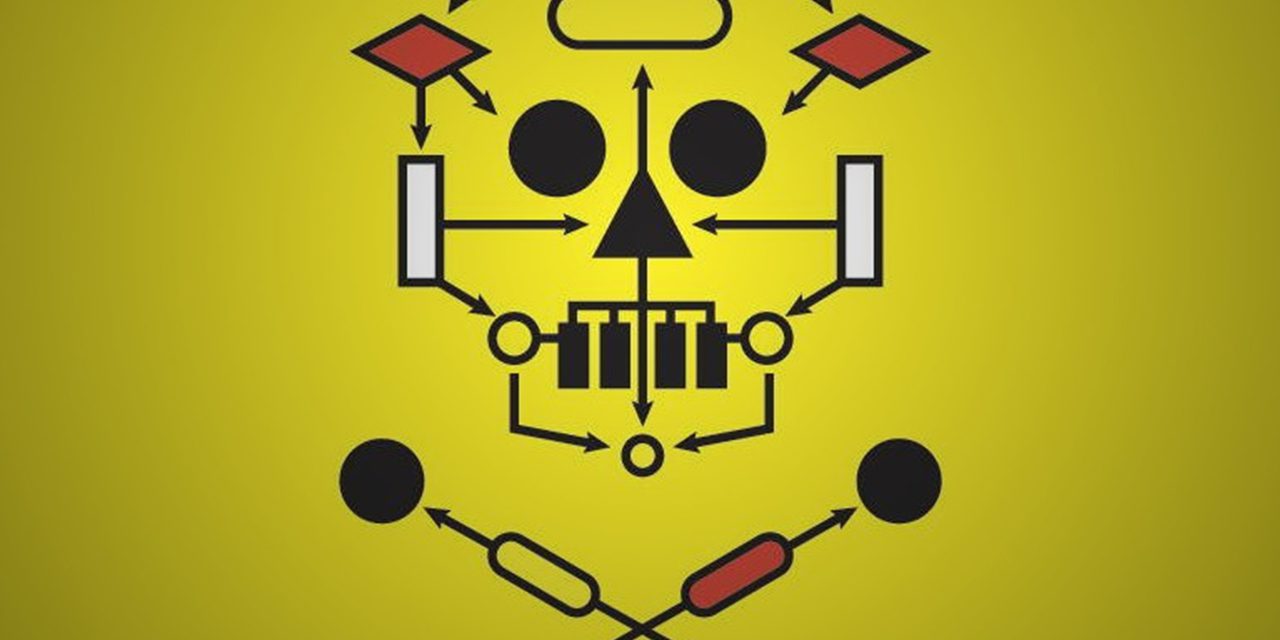

الگوریتمهای نامرئی و همهجا حاضر، در حال نابود کردن زندگی میلیونها نفر هستند

اگر میخواهید بدانید «سلاح کشتار ریاضی» یعنی چه، این سناریو را تصور کنید: یک روز صبح، شما را به اتهام قتل دستگیر میکنند. سوار ماشین پلیس میشوید، و وقتی بعد از ۱۰دقیقه به دادگاه میرسید، حکمِ نهایی را به دستتان میدهند. هوش مصنوعی در این ۱۰دقیقه، با استفاده از کلاندادهها سوابق کیفری شما، الگوهای روانشناختیتان، روابطتان با دیگران، جزئیات ماجرا و هر چیز دیگری را مرور کرده و شما را گناهکار تشخیص داده است. نه نقطۀ مبهمی وجود دارد، نه کسی حوصلۀ شنیدن حرفهایتان را دارد. چه حالی خواهید داشت؟کتی اونیل، دانشمند علوم داده است اصطلاح سلاحهای کشتار ریاضی را وضع کرده تا نشان دهد مدلسازیهای بیقید آماری، هرروزه، دمار از روزگار میلیونها نفر درمیآورند، و زندگیهای بیشتر و بیشتری را به نابودی میکشانند. اونیل کتابی منتشر کرده و عنوانی خارقالعاده، بیپرده و مبارزهطلبانه برآن نهاده:” سلاحهای کشتار ریاضی”

وقتی به یک الگوریتم داده میدهید و از آن میخواهید براساس دادهها برایتان پیشبینی انجام دهد، به شما یک مدل تحویل میدهد. مدلها درست مانند نظرات کارشناسی هستند که در تاروپود ریاضیات تنیده شدهاند. میتوان یک الگوریتم را به نحوی آموزش داد که قد افراد را براساس وزنشان پیشبینی کند، اما اگر همۀ دادههایی که برای آموزش الگوریتم استفاده میکنید مربوط به یک پایه تحصیلی مثلا کلاس سومی ها باشد، و آنهایی را هم که وزن خودشان را میدانند، مستثنی کنید، آنوقت مدل شما پیشبینی میکند که قد بیشتر افراد تقریباً صد و بیست سانتیمتر است. مشکلْ الگوریتم نیست نبودِ سازوکاری برای اصلاح خطا در نتیجهگیری است. اونیل مشتاق است مدلسازیِ برآمده از داده، تبدیل به نیرویی خیر در جهان شود ، این مسئله ناامید کننده است که کارهای بیقید آماری میتوانند با نقاب عینیگرایی ریاضی و به بهای از بین بردن زندگی میلیونها نفر، سودی سرشار نصیب چند شرکت کنند.

امروزه این مدلها را همهجا میتوان یافت. نظام آموزشیِ رسوا و سودمحور ما متوجه شده است که چگونه از مدلها برای شناسایی آدمهای مأیوس استفاده کرده و آنها را فریب دهد تا پایشان را به «دورههای» آموزشی گرانقیمتی باز کند. در ورزش، تیمها از مدلهای جزئینگر آماری برای پیشبینی این موضوع استفاده میکنند که کدام ورزشکار را باید خریداری کنند و هنگام آمادگی برای مسابقه، چگونه آنها را به کار گیرند. بزرگترین کارفرمایان در امریکا از سرویسهای تجاری برای سنجش رزومههای دریافتیشان با مدل کارمند «موفق» استفاده میکنند. آیندۀ شغلی شما در دستان این مدلهاست. شرکت آمازون با دقت، مشتریانی را رصد میکند که دیگر از کارتهای خرید این شرکت استفاده نمیکنند، یا بعد از یکی دو خرید، قید خرید را میزنند. آنها مدلسازیهای آماری را با انسانشناسی -برای فهمیدن و صحبتکردن با خریداران- تلفیق میکنند تا سیستم خودشان را بهتر کنند.

چگونه به اینجا رسیدیم. بسیاری از سلاحهای کشتار ریاضی بهمنزلۀ پاسخی برای خطاهای ساختاری به کار گرفته شدند؛ برای مثال در صدور رأی قضایی، درجهبندی مدارس، پذیرش دانشگاهها، استخدام، و ارائۀ تسهیلات. قرار بود مدلها عاری از سوگیریهای جنسی و نژادی باشند، و امتیازات و ارتباطات افراد نیز در عملکرد آنها تأثیری نداشته باشد.اما متأسفانه، در اغلب موارد، مدلها با دادههایی طراحی میشوند که سوگیری دارند. این مشکل به خوبی در آمار شناخته شده است، اما دلالان سلاحهای کشتار ریاضی نادیدهاش میگیرنداین ها مدلهایشان را براساس دادههای معیوب گذشته طراحی میکنند. کار اونیل مهم است چراکه او به علوم داده ایمان دارد. الگوریتمها را میتوان برای یافتن افرادی به کار بست که با مشکلات دست و پنجه نرم میکنند؛ معلمانی با چالشهایی دشوار، افرادی در تنگنای مالی، آنهایی که در شغلشان تقلا میکنند و دانشآموزانی که به توجه آموزشی نیاز دارند. این دیگر به ما بستگی دارد که چنین اطلاعاتی را درجهت نادیدهگرفتن و بیشتر قربانیکردنشان به کار بندیم، یا به آنها از طریق تخصیص منابع بیشتر کمک کنیم.

مدلها، بسیاری را از میان یکی بیرون میکشند، هرکداممان را بهعنوان عضوی از یک گروه طبقهبندی میکنند. گروههایی که میتوان به کمک آنها تعمیمدهی انجام داد؛ تعمیمهایی که اغلب نیز تنبیهی و کمرشکن هستند مدلسازی از میان نخواهد رفت؛ چراکه مدلها، به عنوان ابزارهایی برای راهنمایی و مراقبت و همچنین به عنوان سیستمهایی مفید و چارهساز، فوقالعادهاند، اما اگر همچون ابزاری برای تنبیه و تضعیف به کار روند، تبدیل به کابوس میشوند. انتخابش با ماست. کتاب اونیل مانند یک دوره به زبانِ ساده است که پیرامون دانش آماری تخصصی نوشته شده است؛ دانشی که همۀ ما برای پرسشگری از سیستمهایی که دورتادورمان را گرفتهاند، و همچنین برای مطالبهگری از آنها، بدان نیاز داریم.

منبع:boingboing